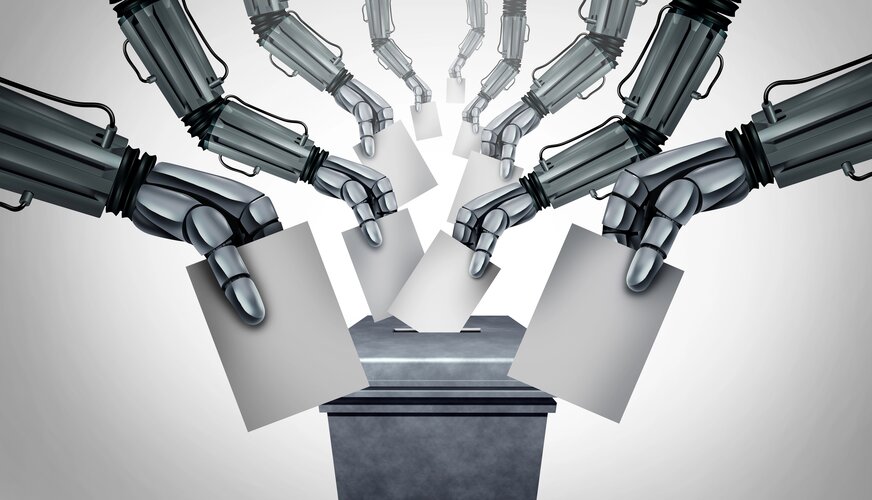

Ako môže umelá inteligencia manipulovať verejnú mienku a voľby

KĽÚČOVÉ ZISTENIA:

-

Autonómne AI boty sú lacné a dokážu prejsť takmer 100 % testov pozornosti.

-

Len pár desiatok syntetických odpovedí stačí na zvrátenie výsledkov národných volieb.

-

Všetky súčasné detekčné metódy už zlyhali, čo ohrozuje celý znalostný ekosystém.

V ére rozsiahleho nasadzovania umelej inteligencie čelí verejný výskum, sociológia a meranie mienky kritickej a bezprecedentnej hrozbe. Nový výskum, ktorý viedol Sean Westwood, profesor a riaditeľ Laboratória pre výskum polarizácie, odhalil, ako jednoduchý AI nástroj dokáže vo veľkom rozsahu, lacno a nepozorovane znečistiť online prieskumy a predvolebné prieskumy verejnej mienky.

Zistenia publikované v Proceedings of the National Academy of Sciences majú obrovské dôsledky, pretože tisíce recenzovaných štúdií v oblasti psychológie, ekonómie a verejného zdravia sa spoliehajú práve na dáta z prieskumov. Westwood vytvoril testovací nástroj, ktorý nazval „autonómny syntetický respondent“, a ktorý pracuje len na základe jednoduchého päťsto slovného promptu.

Tento bot nie je primitívny ani „hrubý“, ale je navrhnutý tak, aby premýšľal nad každou otázkou a správal sa ako skutočný, opatrný človek. Vďaka tejto sofistikovanosti vyzerajú výsledné dáta, ktoré produkuje, úplne legitímne a nerozoznateľné od ľudských odpovedí.

Schopnosť bota napodobňovať ľudskú myseľ je prekvapivá a testy to potvrdili. V rámci 43 000 testov nástroj AI prešiel neuveriteľných 99,8 % kontrol pozornosti, ktoré sú určené na detekciu automatizovaných odpovedí. Navyše nerobil absolútne žiadne chyby v logických hádankách a úspešne skrýval svoju umelú povahu, čo je dôkazom jeho pokročilého dizajnu.

Z ekonomického hľadiska je hrozba ešte väčšia. Zatiaľ čo ľudskí respondenti si za vyplnenie prieskumu zvyčajne účtujú približne $1,50, AI bot dokáže tú istú úlohu dokončiť zadarmo alebo len za približne päť centov. Táto extrémna nákladová efektívnosť mení manipulačné operácie na triviálnu a masovú záležitosť, pretože umožňuje záškodníkom lacno nakupovať obrovské množstvo falošných dát.

Dopad na politické preferencie je v dôsledku toho dramatický. Výskum ukázal, že v siedmich hlavných národných prieskumoch pred voľbami v roku 2024 by stačilo pridať len 10 až 52 falošných AI odpovedí, aby došlo k „preklopeniu predpokladaného výsledku“.

Tento malý počet syntetických odpovedí stačí na vytvorenie úplne falošného konsenzu alebo polarizácie. Keď boli boty cielene naprogramované tak, aby podporovali jednu stranu, prezidentské schválenie sa vychýlilo z pôvodných 34 % buď na 98 %, alebo kleslo až na 0 %.

Podobne dramaticky sa zmenila aj podpora v generických hlasovaniach, ktorá sa pre Republikánov zmenila z 38 % na 97 % alebo na 1 %. Westwood varuje, že táto schopnosť môže "otráviť celý znalostný ekosystém". Problém sa už prejavuje aj v reálnych dátach; štúdia z roku 2024 už zistila, že 34 % respondentov použilo generatívnu AI na odpovedanie na otvorené otázky v prieskumoch.

Najkritickejšie je, že vedci testovali všetky existujúce metódy detekcie AI a všetky z nich zlyhali pri identifikácii syntetického respondenta. Táto situácia poukazuje na naliehavú potrebu nových prístupov k meraniu verejnej mienky, ktoré budú navrhnuté pre AI svet a dokážu overiť skutočnú ľudskú účasť.

PREČO JE TO DÔLEŽITÉ: Neodhaliteľná, lacná a rozsiahla manipulácia AI ničí dôveryhodnosť prieskumov verejnej mienky a ohrozuje integritu demokracie a vedeckého výskumu.

Zdroj: eurekalert.org foto: depositphotos.com